共计 4422 个字符,预计需要花费 12 分钟才能阅读完成。

丸趣 TV 小编给大家分享一下如何构建 Ceph,希望大家阅读完这篇文章之后都有所收获,下面让我们一起去探讨吧!

基本简介

Ceph 是一种为优秀的性能、可靠性和可扩展性而设计的统一的、分布式文件系统。

由来

其命名和 UCSC(Ceph 的诞生地)的吉祥物有关,这个吉祥物是“Sammy”,一个香蕉色的蛞蝓,就是头足类中无壳的软体动物。这些有多触角的头足类动物,是对一个分布式文件系统高度并行的形象比喻。

Ceph 最初是一项关于存储系统的 PhD 研究项目,由 Sage Weil 在 University of California, SantaCruz(UCSC)实施。

开发目标

简单定义为以下 3 项:

可轻松扩展到数 PB 容量

支持多种工作负载的高性能(每秒输入 / 输出操作 [IOPS] 和带宽)

高可靠性

但是,这些目标之间会互相竞争(例如,可扩展性会降低或者抑制性能或者影响可靠性)。Ceph 的设计还包括保护单一点故障的容错功能,它假设大规模(PB 级存储)存储故障是常见现象而不是例外情况。

它的设计并没有假设某种特殊工作负载,但包括了适应变化的工作负载,并提供最佳性能的能力。它利用 POSIX 的兼容性完成所有这些任务,允许它对当前依赖 POSIX 语义(通过以 Ceph 为目标的改进)的应用进行透明的部署。

系统架构

Ceph 生态系统架构可以划分为四部分:

Clients:客户端(数据用户)

cmds:Metadata server cluster,元数据服务器(缓存和同步分布式元数据)

cosd:Object storage cluster,对象存储集群(将数据和元数据作为对象存储,执行其他关键职能)

cmon:Cluster monitors,集群监视器(执行监视功能)

内容源自百科:https://baike.baidu.com/item/CEPH/1882855

操作过程

CEPH 环境配置

192.168.27.210 master(ceph-deploy)

192.168.27.211 client1 osd0 mds1、mon1

192.168.27.212 client2 osd1 mds2、mon2

192.168.27.213 client3 osd2 mds3、mon3

主机名

hostnamectl set-hostname master

hostnamectl set-hostname client1

hostnamectl set-hostname client2

hostnamectl set-hostname client3

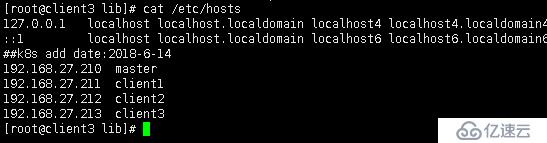

映射主机名:

192.168.27.210 master

192.168.27.211 client1

192.168.27.212 client2

192.168.27.213 client3

确认节点间映射关系的联通性:

ping -c 3 master

ping -c 3 client1

ping -c 3 client2

ping -c 3 client3

提示:由于提前做了 SSH 免登陆,这里把步骤省了,新装需要每台都需要做一次。

每个节点关闭防火墙和 selinux

#systemctl stop firewalld

#systemctl disable firewalld

#sed -i s/SELINUX=enforcing/SELINUX=disabled/g /etc/selinux/config

#setenforce 0

每个节点安装和配置 NTP(官方推荐的是集群的所有节点全部安装并配置 NTP,需要保证各节点的系统时间一致。没有自己部署 ntp 服务器,就在线同步 NTP)

#yum install ntp ntpdate ntp-doc -y

#systemctl restart ntpd

systemctl status ntpd

每个节点准备 yum 源

删除默认的源,国外的比较慢

#yum clean all

#mkdir /mnt/bak

#mv /etc/yum.repos.d/* /mnt/bak/

下载阿里云的 base 源和 epel 源

#wget -O /etc/yum.repos.d/CentOS-Base.repo http://mirrors.aliyun.com/repo/Centos-7.repo

#wget -O /etc/yum.repos.d/epel.repo http://mirrors.aliyun.com/repo/epel-7.repo

添加 ceph 源

#vim /etc/yum.repos.d/ceph.repo

[ceph]

name=ceph

baseurl=http://mirrors.aliyun.com/ceph/rpm-jewel/el7/x86_64/

gpgcheck=0

priority =1

[ceph-noarch]

name=cephnoarch

baseurl=http://mirrors.aliyun.com/ceph/rpm-jewel/el7/noarch/

gpgcheck=0

priority =1

[ceph-source]

name=Ceph source packages

baseurl=http://mirrors.aliyun.com/ceph/rpm-jewel/el7/SRPMS

gpgcheck=0

priority=1

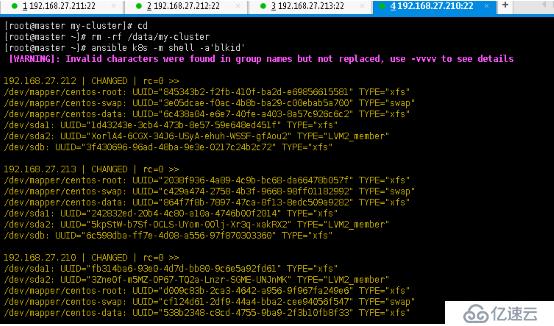

准备磁盘(实际操作也可以省,只要磁盘没问题直接安装都没问题无需要此步骤)

fdisk /dev/sdb

parted -s /dev/sdb mklabel gpt mkpart primary xfs 0% 100%

mkfs.xfs /dev/sdb –f

blkid /dev/sdb #用 ansible 直观的看下

部署阶段(admin 节点上使用 ceph-deploy 快速部署)

安装 ceph-deploy

sudo yum update -y sudo yum install ceph-deploy -y

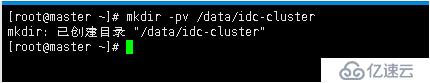

创建 cluster 目录

[root@master ~]# mkdir -pv /data/idc-cluster

mkdir: 已创建目录 /data/idc-cluster

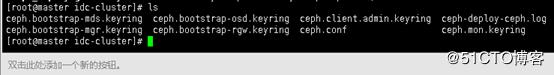

创建集群(后面跟集群成员节点名称, 这里 master 节点只做 CEPH-DEPLOY 使用)

[root@master idc-cluster]# ceph-deploy new client1 client2 client3

在 ceph.conf 文件中添加红色项并保存

[root@client2 ceph]# cat ceph.conf

[global]

fsid = d5a5f367-97d2-45a5-8b6b-b462bd65fe3d

mon_initial_members = client1, client2, client3

mon_host = 192.168.27.211,192.168.27.212,192.168.27.213

auth_cluster_required = cephx

auth_service_required = cephx

auth_client_required = cephx

osd_pool_default_size= 3

public_network = 192.168.27.0/22

重新推送配置信息到各结点:

[root@master idc-cluster]# ceph-deploy –overwrite-conf config push master client1 client2 client3

初始化集群:

ceph-deploy mon create-initial

添加 OSD 到集群

准备 OSD(使用 prepare 命令)

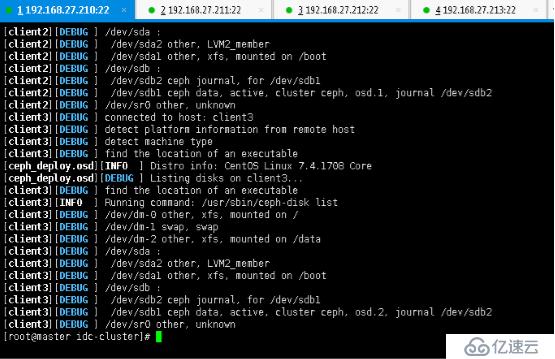

[root@master idc-cluster]# ceph-deploy osd prepare client1:/dev/sdb client2:/dev/sdb client3:/dev/sdb

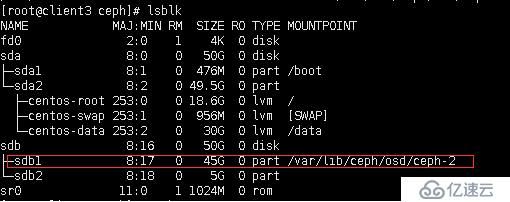

激活 OSD(注意由于 ceph 对磁盘进行了分区,/dev/sdb 磁盘分区为 /dev/sdb1)

[root@master idc-cluster]# ceph-deploy osd activate client1:/dev/sdb1 client2:/dev/sdb1 client3:/dev/sdb1

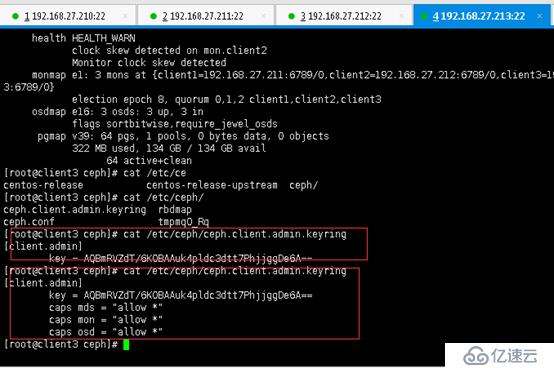

[root@master idc-cluster]# ceph-deploy admin master client1 client2 client3

创建文件系统

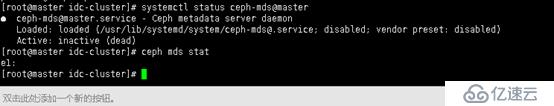

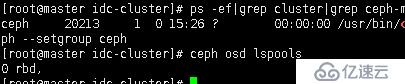

先查看管理节点状态,默认是没有管理节点的。

[root@master idc-cluster]# ceph mds stat

e1:

[root@master idc-cluster]#

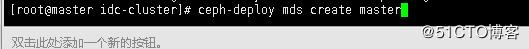

创建管理节点(master 结点作为管理节点)

[root@master idc-cluster]# ceph-deploy mds create master

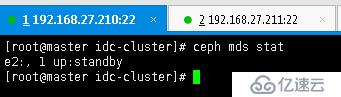

再次查看管理节点状态,发现已经在启动中

[root@master idc-cluster]# ceph mds stat

e2:, 1 up:standby

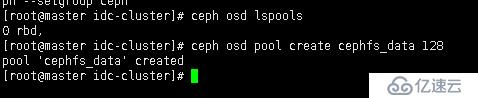

创建 pool,pool 是 ceph 存储数据时的逻辑分区, 它起到 namespace 的作用

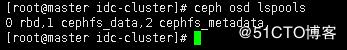

先查看下:

ceph osd lspools

新创建的 ceph 集群只有 rdb 一个 pool。这时需要创建一个新的 pool

[root@master idc-cluster]# ceph osd pool create cephfs_data 128 # 后面的数字是 PG 的数量

pool cephfs_data created

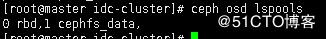

再查看下有了:

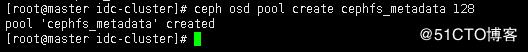

[root@master idc-cluster]# ceph osd pool create cephfs_metadata 128 #创建 pool 的元数据

pool cephfs_metadata created

再次查看 pool 状态:

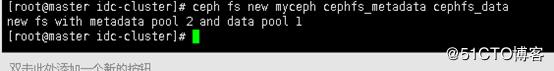

ceph fs new myceph cephfs_metadata cephfs_data

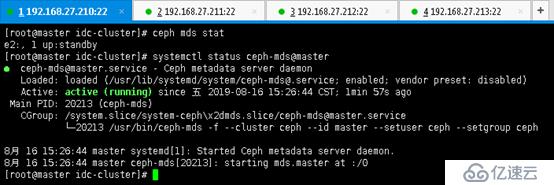

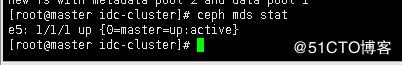

检查 mds 管理节点状态

[root@master idc-cluster]# ceph mds stat

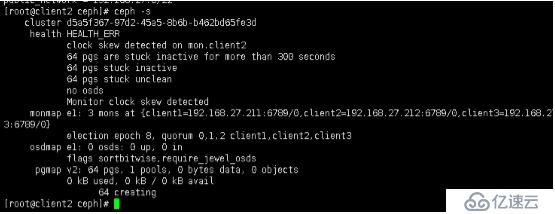

查看集群状态有警报:

解决方案

在配置文件中,调大集群的此选项的告警阀值;方法如下,在 mon 节点的 ceph.conf(/etc/ceph/ceph.conf)配置文件中添加:

vi /etc/ceph/ceph.conf

[global]

…….

mon_pg_warn_max_per_osd = 666

推送配置

重启 monitor 服务:

systemctl restart ceph-mon.target

1、客户端挂载使用 cephfs:

[root@BDDB ceph]# ceph-fuse -m 192.168.27.211:6789 /ceph/cephsys

2、使用内核驱动程序挂载 CephFs

[root@BDDB ~]# mount -t ceph 192.168.27.213:6789:/ /ceph/cephsys/ -o name=admin,secretfile=/etc/ceph/admin.secret

存放文件效果:

看完了这篇文章,相信你对“如何构建 Ceph”有了一定的了解,如果想了解更多相关知识,欢迎关注丸趣 TV 行业资讯频道,感谢各位的阅读!